Google a annoncé que le mode AI prend désormais en charge la recherche visuelle, vous permettant d’utiliser des images et un langage naturel ensemble dans la même conversation.

Le mise à jour Déplace cette semaine en anglais aux États-Unis

Quoi de neuf

La recherche visuelle devient conversationnelle

La mise à jour de Google vers le mode AI vise à relever le défi de rechercher quelque chose de difficile à décrire.

Vous pouvez commencer par du texte ou une image, puis affiner les résultats naturellement avec des questions de suivi.

Robby Stein, vice-président de la gestion des produits pour Google Search, et Lilian Rincon, vice-président de la gestion des produits pour Google Shopping, ont écrit:

« Nous avons tous été là: regarder un écran, chercher quelque chose que vous ne pouvez pas tout à fait mettre en mots. Mais que se passe-t-il si vous pouviez simplement montrer ou dire à Google ce que vous pensez et obtenir une riche gamme de résultats visuels? »

Google fournit un exemple qui commence par une recherche de «l’inspiration maximaliste des chambres» et est raffiné avec «plus d’options avec des tons sombres et des impressions audacieuses».

Crédit d’image: Google

Crédit d’image: Google Crédit d’image: Google

Crédit d’image: GoogleChaque image se lie à sa source, afin que les chercheurs puissent cliquer sur lorsqu’ils trouvent ce qu’ils veulent.

Faire du shopping sans filtres

Plutôt que d’utiliser des filtres conventionnels pour le style, la taille, la couleur et la marque, vous pouvez décrire les produits en conversation.

Par exemple, demander «un jean baril qui n’est pas trop ample» trouvera des produits appropriés, et vous pouvez réduire davantage les options avec des demandes comme «Montre-moi la longueur de la cheville».

Crédit d’image: Google

Crédit d’image: GoogleCette expérience est alimentée par le graphique d’achat, qui s’étend sur plus de 50 milliards de listes de produits de grands détaillants et de magasins locaux.

La société affirme que plus de 2 milliards d’annonces sont actualisées toutes les heures pour conserver des détails tels que les avis, les offres, les couleurs disponibles et le statut de stock à jour.

Fondation technique

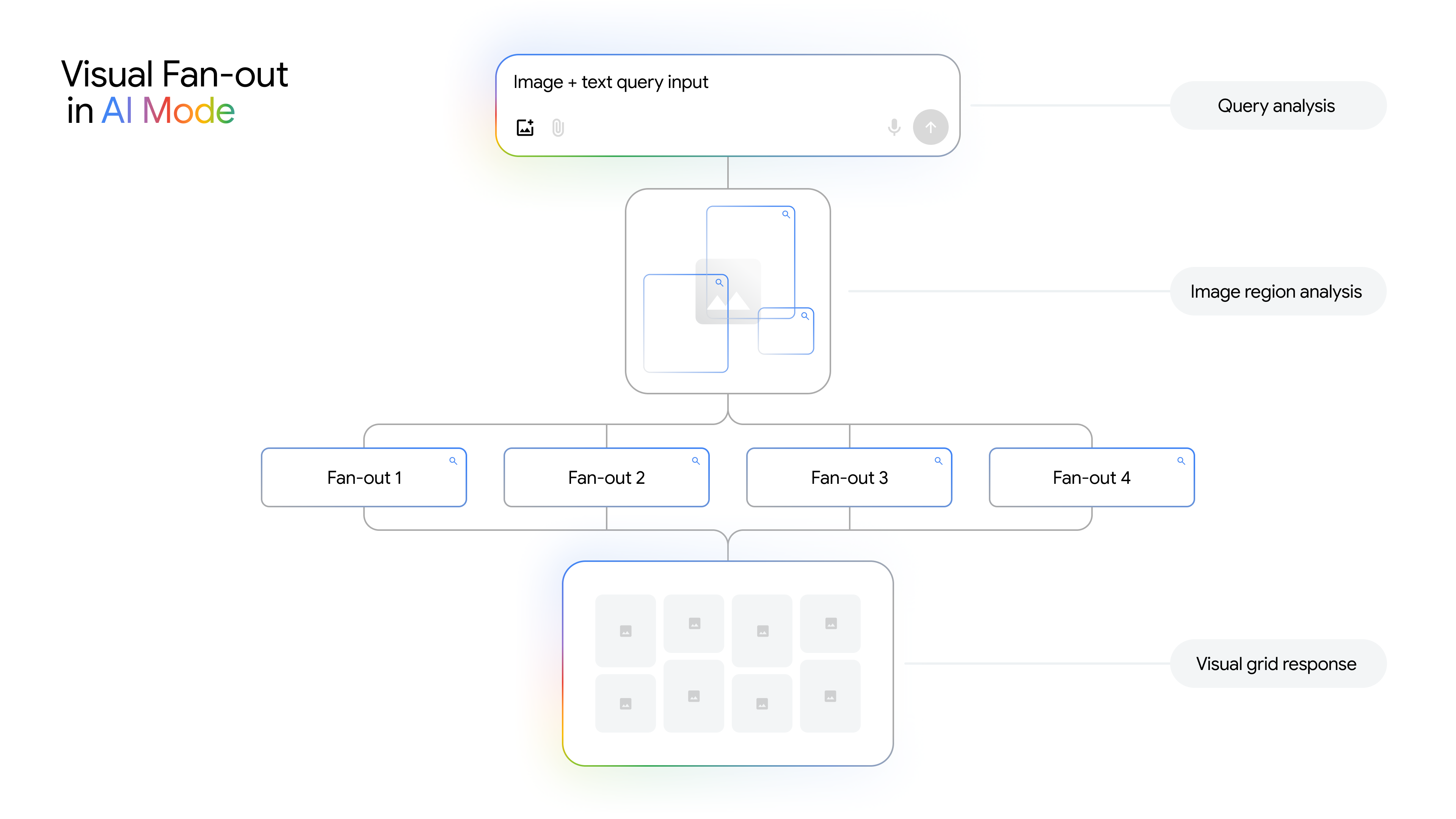

S’appuyant sur l’objectif et la recherche d’images, les capacités visuelles incluent désormais une compréhension avancée multimodale et linguistique de Gemini 2.5.

Google présente une technique appelée «Visual Search Fan-out», où il exécute plusieurs requêtes connexes en arrière-plan pour mieux comprendre ce qu’il y a dans une image et les nuances de votre question.

De plus, sur les appareils mobiles, vous pouvez rechercher dans une image spécifique et demander des suivis conversationnels sur ce que vous voyez.

Crédit d’image: Google

Crédit d’image: GoogleContexte supplémentaire

Dans une table ronde des médias à laquelle est assisté par Search Engine Journal, un porte-parole de Google a déclaré:

- Lorsqu’une requête comprend des modificateurs subjectifs, tels que «trop amples», le système peut utiliser des signaux de personnalisation pour déduire ce que vous signifiez probablement et renvoyer des résultats qui correspondent mieux à cette préférence. Le porte-parole n’a pas détaillé quels signaux sont utilisés ni comment ils sont pondérés.

- Pour les sources d’image, les systèmes ne différencient pas explicitement les photos réelles des images générées par l’IA pour cette fonctionnalité. Cependant, le classement peut favoriser les résultats de sources faisant autorité et d’autres signaux de qualité, ce qui peut rendre les vraies photos plus susceptibles d’apparaître dans certains cas. Aucune politique ou norme de détection distincte n’a été partagée.

Pourquoi cela compte

Pour les équipes de référencement et de commerce électronique, les images deviennent encore plus essentielles. Alors que Google s’améliore pour comprendre les indices visuels détaillés, les photos de produits de haute qualité et les images de style de vie peuvent augmenter votre visibilité.

Étant donné que Google met à jour le graphique d’achat toutes les heures, il est important de garder vos flux de produits précis et à jour.

Alors que la recherche continue de devenir plus visuelle et conversationnelle, n’oubliez pas que de nombreuses expériences d’achat pourraient commencer par une image simple ou une description décontractée au lieu de mots clés exacts.

En avant

La nouvelle expérience se déroule cette semaine en anglais aux États-Unis, Google n’a pas partagé de calendrier pour d’autres langues ou régions.

Commentaires