OpenAI a publié deux nouveaux modèles de langue ouverte sous la licence APACHE 2.0 permissive. Ces modèles sont conçus pour offrir de fortes performances réelles tout en fonctionnant sur le matériel de consommation, y compris un modèle qui peut fonctionner sur un ordinateur portable haut de gamme avec seulement 16 Go de GPU.

Performances du monde réel à un coût matériel inférieur

Les deux modèles sont:

- GPT-OSS-120B (117 milliards de paramètres)

- GPT-OSS-20B (21 milliards de paramètres)

Le modèle GPT-ASS-120B plus grand correspond à O4-MINI d’OpenAI sur les références de raisonnement tout en ne nécessitant qu’un seul GPU de 80 Go. Le modèle GPT-OSS-20B plus petit fonctionne de manière similaire à O3-MINI et fonctionne efficacement sur des appareils avec seulement 16 Go de GPU. Cela permet aux développeurs d’exécuter les modèles sur les machines grand public, ce qui facilite le déploiement sans infrastructure coûteuse.

Raisonnement avancé, utilisation des outils et chaîne de réflexion

Openai explique que les modèles surpassent d’autres modèles open source de tailles similaires sur les tâches de raisonnement et l’utilisation des outils.

Selon Openai:

«Ces modèles sont compatibles avec nos réponses api (s’ouvre dans une nouvelle fenêtre) et sont conçues pour être utilisées dans des flux de travail agentiques avec une instruction exceptionnelle suivant, une utilisation des outils comme la recherche Web ou l’exécution du code Python, et des capacités de raisonnement, y compris la possibilité d’ajuster l’effort de raisonnement pour les tâches qui ne nécessitent pas de raisonnement complexe et de cibler les sorties finales. Sorties (s’ouvre dans une nouvelle fenêtre). »

Conçu pour la flexibilité et l’intégration des développeurs

Openai a sorti Guides du développeur Pour soutenir l’intégration avec des plateformes comme Visage étreint, Girubvllm, olllama et llama.cpp. Les modèles sont compatibles avec l’API des réponses d’OpenAI et prennent en charge les comportements avancés de suivi des instructions et de raisonnement. Les développeurs peuvent affiner les modèles et mettre en œuvre des garde-corps de sécurité pour les applications personnalisées.

Sécurité dans les modèles d’IA de poids ouvert

Openai a abordé ses modèles ouverts dans le but d’assurer la sécurité tout au long de la formation et de la libération. Les tests ont confirmé que même sous un réglage fin délibérément malveillant, le GPT-OSS-120B n’a pas atteint un niveau de capacité dangereux dans les zones de biologique, chimique ou de cyber-risque.

Chaîne de pensée non filtrée

OpenAI quitte intentionnellement la chaîne de pensée (COTS) non filtrée pendant la formation pour préserver leur utilité pour la surveillance, en fonction de la préoccupation que l’optimisation pourrait entraîner des modèles pour cacher leur réel raisonnement. Cependant, cela pourrait entraîner des hallucinations.

Selon leur carte modèle (Version pdf):

«Dans nos récentes recherches, nous avons constaté que la surveillance de la chaîne de pensée d’un modèle de raisonnement peut être utile pour détecter les mauvais comportements. Nous avons en outre constaté que les modèles pourraient apprendre à cacher leur réflexion tout en se comportant si leurs Cots étaient directement pressés de les« mauvaises pensées ».

Plus récemment, nous avons rejoint un document de position avec un certain nombre d’autres laboratoires arguant que les développeurs de frontières devraient «considérer l’impact des décisions de développement sur la surveillance du COT».

Conformément à ces préoccupations, nous avons décidé de ne pas exercer de pression d’optimisation directe sur le COT pour l’un ou l’autre de nos deux modèles de poids ouvert. Nous espérons que cela donne aux développeurs la possibilité de mettre en œuvre des systèmes de surveillance de COT dans leurs projets et permet à la communauté de recherche d’étudier la surveillance du COT. »

Impact sur les hallucinations

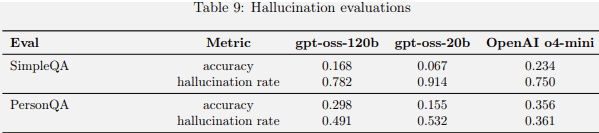

La documentation OpenAI indique que la décision de ne pas restreindre la chaîne de pensée se traduit par des scores d’hallucination plus élevés.

La version PDF de la carte modèle explique pourquoi cela se produit:

Parce que ces chaînes de pensée ne sont pas restreintes, elles peuvent contenir du contenu halluciné, y compris un langage qui ne reflète pas les politiques de sécurité standard d’OpenAI. Les développeurs ne doivent pas montrer directement des chaînes de réflexion aux utilisateurs de leurs applications, sans plus de filtrage, de modération ou de résumé de ce type de contenu. »

L’analyse comparative a montré que les deux modèles open source fonctionnaient moins bien sur les repères d’hallucination par rapport à Openai O4-MinI. La documentation PDF de la carte de modèle a expliqué que cela devait s’attendre à ce que les nouveaux modèles sont plus petits et implique que les modèles hallucineront moins dans des paramètres agentiques ou lors de la recherche d’informations sur le Web (comme RAG) ou l’extrait de l’extraction d’une base de données.

Openai Oss Hallucination Scores d’analyse comparative

Plats à emporter

- Libération de poids ouvert

OpenAI a publié deux modèles ouverts sous la licence APACHE 2.0 permissive. - Performance vs. Coût du matériel

Les modèles offrent de solides performances de raisonnement tout en fonctionnant sur du matériel abordable du monde réel, ce qui les rend largement accessibles. - Modèle de spécifications et de capacités

GPT-OSS-120B correspond à O4-Mini sur le raisonnement et fonctionne sur 80 Go GPU; GPT-OSS-20B fonctionne de manière similaire à O3-MINI sur les références de raisonnement et fonctionne efficacement sur un GPU 16 Go. - Flux de travail agentique

Les deux modèles prennent en charge les sorties structurées, l’utilisation des outils (comme Python et la recherche Web) et peuvent mettre à l’échelle leur effort de raisonnement en fonction de la complexité des tâches. - Personnalisation et intégration

Les modèles sont conçus pour s’adapter aux flux de travail agentiques et peuvent être entièrement adaptés à des cas d’utilisation spécifiques. Leur support pour les sorties structurées les rend adaptables aux systèmes logiciels complexes. - Utilisation d’outils et appels de fonction

Les modèles peuvent effectuer des appels de fonction et une utilisation d’outils avec une invitation à quelques tirs, ce qui les rend efficaces pour les tâches d’automatisation qui nécessitent un raisonnement et une adaptabilité. - Collaboration avec des utilisateurs du monde réel

OpenAI a collaboré avec des partenaires tels que l’IA Suède, Orange et Snowflake pour explorer les utilisations pratiques des modèles, y compris le déploiement sur place sécurisé et le réglage fin personnalisé sur des ensembles de données spécialisés. - Optimisation de l’inférence

Les modèles utilisent le mélange des experts (MOE) pour réduire la charge de calcul et l’attention multi-requête groupée pour l’inférence et l’efficacité de la mémoire, ce qui les rend plus faciles à exécuter à moindre coût. - Sécurité

Les modèles open source d’OpenAI maintiennent la sécurité même sous un réglage fin malveillant; La chaîne de pensées (COTS) n’est pas filtrée pour la transparence et la surveillance. - Compromis de transparence du lit

Aucune pression d’optimisation appliquée aux COTS pour empêcher le masquage de raisonnement nocif; peut entraîner des hallucinations. - Hallucinations Benchmarks et performance du monde réel

Les modèles sous-performent O4-MinI sur des repères d’hallucination, qui ouvrent les attributs à leur taille plus petite. Cependant, dans les applications du monde réel où les modèles peuvent rechercher des informations à partir du Web ou de la question des ensembles de données externes, les hallucinations devraient être moins fréquentes.

Image en vedette par Shutterstock / Good Dreams – Studio

Commentaires