Posez une question dans le chatppt, la perplexité, les Gémeaux ou le copilote, et la réponse apparaît en quelques secondes. C’est sans effort. Mais sous le capot, il n’y a pas de magie. Il y a un combat.

Ceci fait partie du pipeline où votre contenu est dans une lutte au couteau avec tous les autres candidats. Chaque passage de l’index veut être celui que le modèle sélectionne.

Pour les SEO, c’est un nouveau champ de bataille. Le référencement traditionnel était de se classer sur une page de résultats. Maintenant, le concours se produit dans un système de sélection de réponses. Et si vous voulez la visibilité, vous devez comprendre comment ce système fonctionne.

Crédit d’image: Duane Forrester

Crédit d’image: Duane ForresterL’étape de sélection des réponses

Ce n’est pas ramper, indexer ou intégrer dans une base de données vectorielle. Cette partie se fait avant que la requête ne se produise. Réponse La sélection entre en jeu après qu’un utilisateur pose une question. Le système a déjà du contenu, intégré et stocké. Ce qu’il doit faire, c’est de trouver des passages candidats, de les marquer et de décider lesquels passer dans le modèle de génération.

Chaque pipeline de recherche d’IA moderne utilise les trois mêmes étapes (sur quatre étapes): récupération, ré-évaluation et vérification de la clarté. Chaque étape est importante. Chacun a du poids. Et tandis que chaque plate-forme a sa propre recette (la pondération attribuée à chaque étape / étape), la recherche nous donne suffisamment de visibilité pour esquisser un point de départ réaliste. Pour construire essentiellement notre propre modèle pour reproduire au moins partiellement ce qui se passe.

La ligne de base du constructeur

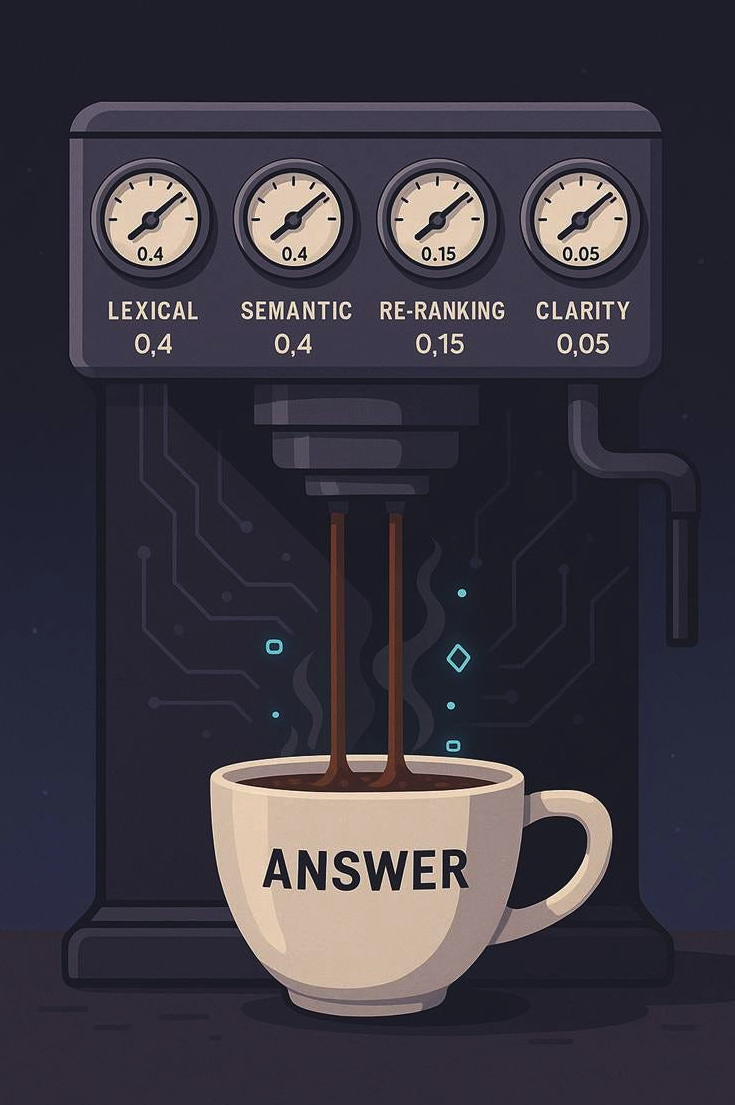

Si vous construisiez votre propre système de recherche basé sur LLM, vous devez lui dire combien chaque étape compte. Cela signifie attribuer des poids normalisés qui somment à un.

Une pile de départ défendable et axée sur la recherche peut ressembler à ceci:

- Retriel lexical (mots clés, BM25): 0,4.

- Retriel sémantique (intégres, signification): 0,4.

- REGANGEMENT (notation croisée): 0,15.

- Clarity and Structural Boosts: 0,05.

Chaque système d’IA majeur a son propre mélange propriétaire, mais ils se préparent tous essentiellement aux mêmes ingrédients de base. Ce que je vous montre ici, c’est le point de départ moyen d’un système de recherche d’entreprise, pas exactement avec quoi fonctionne Chatgpt, Perplexity, Claude, Copilot ou Gemini. Nous ne connaîtrons jamais ces poids.

Les défauts hybrides dans toute l’industrie le soutiennent. Faire passer Paramètre alpha de recherche hybride par défaut à 0,5, un équilibre égal entre la correspondance des mots clés et les incorporations. Pignon enseigne le même défaut dans son aperçu hybride.

La relance obtient 0,15 car elle ne s’applique qu’à la liste courte. Pourtant, son impact est éprouvé: «Le passage du passage avec Bert» a montré des gains de précision majeurs lorsque Bert a été superposé sur la récupération de BM25.

La clarté obtient 0,05. C’est petit, mais réel. Un passage qui mène à la réponse est dense de faits et peut être levé entier, est plus susceptible de gagner. Qui correspond aux résultats de ma propre pièce sur chevauchement sémantique vs densité.

À première vue, cela peut ressembler à «juste du référencement avec des mathématiques différents». Ce n’est pas. Le référencement traditionnel a toujours été des suppositions dans une boîte noire. Nous n’avons jamais vraiment eu accès aux algorithmes dans un format proche de leurs versions de production. Avec les systèmes LLM, nous avons enfin quelque chose que la recherche ne nous a jamais vraiment donné: l’accès à toutes les recherches sur lesquelles ils ont construit. Les articles de récupération denses, les méthodes de fusion hybride, les modèles de relance, ils sont tous publics. Cela ne signifie pas que nous savons exactement comment Chatgpt ou Gemini compose leurs boutons, ou écoutent leurs poids, mais cela signifie que nous pouvons esquisser un modèle de la façon dont ils fonctionnent probablement beaucoup plus facilement.

Du poids à la visibilité

Alors, qu’est-ce que cela signifie si vous ne construisez pas la machine mais en concurrence à l’intérieur?

Le chevauchement vous amène dans la pièce, la densité vous rend crédible, la lexicale vous empêche d’être filtrée et la clarté fait de vous le gagnant.

C’est la logique de la pile de sélection des réponses.

Récupération lexicale est encore 40% du combat. Si votre contenu ne contient pas les mots que les gens utilisent réellement, vous n’entrez même pas dans le pool.

Récupération sémantique est encore 40%. C’est là que les intégres capturent le sens. Un paragraphe qui lie les concepts liés ensemble s’accompagne mieux que celui qui est mince et isolé. C’est ainsi que votre contenu est repris lorsque les utilisateurs expliquent les requêtes d’une manière que vous ne l’avez pas prévu.

Recommandation est 15%. C’est là que la clarté et la structure comptent le plus. Les passages qui ressemblent à des réponses directes augmentent. Des passages qui enterrent la conclusion baisse.

Clarté et structure sont le bris d’égalité. 5% peuvent ne pas sembler beaucoup, mais dans les combats étroits, cela décide qui gagne.

Deux exemples

Contenu d’aide de Zapier

La documentation de Zapier est célèbre et répond d’abord. Une requête comme « Comment connecter les feuilles Google à Slack« Renvoie une réponse Chatgpt qui commence par les étapes exactes décrites car le contenu de Zapier fournit les données exactes nécessaires. Lorsque vous cliquez sur un lien de ressources ChatGpt, la page sur laquelle vous atterrissez n’est pas un article de blog; ce n’est probablement pas un article d’aide. C’est la page réelle qui vous permet d’accomplir la tâche que vous avez demandé.

- Lexical? Fort. Les mots «feuilles de Google» et «Slack» sont là.

- Sémantique? Fort. Le passage clusters a lié des termes comme «l’intégration», le «flux de travail» et le «déclencheur».

- REGANT? Fort. Les étapes mènent avec la réponse.

- Clarté? Très fort. Formatage numérisable et réponses.

Dans un système 0,4 / 0,4 / 0,15 / 0,05, les scores de morceaux de Zapier sur tous les cadrans. C’est pourquoi leur contenu apparaît souvent dans les réponses d’IA.

Un article de blog marketing

Comparez cela avec un article de blog marketing long marketing typique sur les «hacks de productivité d’équipe». Le message mentionne Slack, Google Sheets et les intégrations, mais seulement après 700 mots d’histoire.

- Lexical? Présent, mais enterré.

- Sémantique? Décent, mais dispersé.

- REGANT? Faible. La réponse à « Comment connecter les feuilles à Slack? » est caché dans un paragraphe à mi-chemin.

- Clarté? Faible. Pas de réponse à la réponse préalable.

Même si le contenu couvre techniquement le sujet, il se débat dans ce modèle de pondération. Le passage Zapier gagne car il s’aligne sur la façon dont la couche de sélection des réponses fonctionne réellement.

La recherche traditionnelle guide toujours l’utilisateur pour lire, évaluer et décider si la page il atterrisse sur ses besoins. Les réponses AI sont différentes. Ils ne vous demandent pas d’analyser les résultats. Ils mappent votre intention directement à la tâche ou à la réponse et vous déplacent directement dans le mode «Faites-le faire». Vous demandez: « Comment connecter des feuilles Google à Slack,»Et vous vous retrouvez avec une liste de mesures ou un lien vers la page où le travail est terminé. Vous n’obtenez pas vraiment un article de blog expliquant comment quelqu’un a fait cela pendant leur pause déjeuner, et cela n’a pris que cinq minutes.

Volatilité sur toutes les plates-formes

Il y a une autre différence majeure avec le référencement traditionnel. Les moteurs de recherche, malgré les changements d’algorithme, ont convergé au fil du temps. Posez la même question à Google et Bing, et vous verrez souvent des résultats similaires.

Les plates-formes LLM ne convergent pas, ou du moins, ne sont pas jusqu’à présent. Posez la même question en perplexité, Gemini et Chatgpt, et vous obtiendrez souvent trois réponses différentes. Cette volatilité reflète la façon dont chaque système pèse ses cadrans. Les Gémeaux peuvent mettre l’accent sur les citations. La perplexité peut récompenser l’étendue de la récupération. Chatgpt peut compresser agressivement pour le style conversationnel. Et nous avons des données qui montrent qu’entre un moteur traditionnel et une plate-forme de réponse alimentée par LLM, il y a un large fossé entre les réponses. Les données de BrightEdge (62% de désaccord sur les recommandations de la marque) et Données de Defound (… Les modules d’IA et les moteurs de réponse diffèrent considérablement des moteurs de recherche, avec seulement 8 à 12% de chevauchement des résultats) le montrez clairement.

Pour les SEO, cela signifie que l’optimisation n’est plus unique. Votre contenu peut bien fonctionner dans un système et mal dans un autre. Cette fragmentation est nouvelle, et vous devrez trouver des moyens de le traiter en tant que comportement des consommateurs à l’aide de ces plateformes pour les changements de réponses.

Pourquoi cela compte

Dans l’ancien modèle, des centaines de facteurs de classement se sont élégants dans un «meilleur effort» consensuel. Dans le nouveau modèle, c’est comme si vous étiez affaire à quatre grands cadrans, et chaque plate-forme les coupe différemment. En toute honnêteté, la complexité derrière ces cadrans est encore assez vaste.

Ignorez le chevauchement lexical et vous perdez une partie de ces 40% des voix. Écrivez un contenu sémantiquement mince, et vous pouvez perdre 40 autres. Rambler ou enterrer votre réponse, et vous ne gagnerez pas de réévaluation. Pad avec des peluches et vous manquez le boost de clarté.

Le combat au couteau ne se produit plus sur un SERP. Cela se produit à l’intérieur du pipeline de sélection des réponses. Et il est très peu probable que ces cadrans soient statiques. Vous pouvez parier qu’ils se déplacent par rapport à de nombreux autres facteurs, y compris le positionnement relatif de chacun.

La couche suivante: vérification

Aujourd’hui, la sélection des réponses est la dernière porte avant la génération. Mais l’étape suivante est déjà en vue: la vérification.

La recherche montre comment les modèles peuvent se critiquer et augmenter la factualité. S’auto-sèche démontre des boucles de récupération, de génération et de critique. Selfocheckgpt Effectue des vérifications de cohérence sur plusieurs générations. Openai est signalé Pour construire un vérificateur universel pour GPT-5. Et, j’ai écrit sur tout ce sujet dans un récent Article.

Lorsque les couches de vérification mûrissent, la récupération ne vous amènera que dans la pièce. La vérification décidera si vous y restez.

Clôture

Ce n’est vraiment pas un référencement régulier déguisé. C’est un changement. Nous pouvons maintenant voir plus clairement les engrenages tourner car une plus grande partie de la recherche est publique. Nous voyons également la volatilité car chaque plate-forme fait tourner ces engrenages différemment.

Pour les SEO, je pense que le point à retenir est clair. Gardez le chevauchement lexical fort. Construisez la densité sémantique en grappes. Diriger avec la réponse. Rendre les passages concis et soulables. Et je comprends à quel point cela ressemble à des conseils de référencement traditionnels. Je comprends également comment les plateformes utilisant les informations diffèrent tellement des moteurs de recherche réguliers. Ces différences sont importantes.

C’est ainsi que vous survivez au combat au couteau à l’intérieur de l’IA. Et bientôt, comment vous passez le test du vérificateur une fois que vous y êtes.

Plus de ressources:

Ce message a été initialement publié sur Duane Forrester Decodes.

Image en vedette: Tete_escape / Shutterstock

Commentaires