Robby Stein, vice-président des produits chez Google, a expliqué que la recherche Google converge avec l’IA d’une nouvelle manière qui s’appuie sur trois piliers de l’IA. Les implications pour les éditeurs en ligne, les référenceurs et les magasins de commerce électronique sont profondes.

Trois piliers de la recherche IA

Stein, de Google, a déclaré que la « prochaine génération » de recherche Google comporte trois éléments essentiels :

- Aperçus de l’IA

- Recherche multimodale

- AI Mode

AI Overviews est une recherche en langage naturel. Le multimodal est une nouvelle façon de rechercher avec des images, activée par Google Lens. Le mode IA consiste à exploiter le contenu Web et les connaissances structurées pour fournir un moyen conversationnel au tour par tour de découvrir des informations et d’apprendre. Stein indique que ces trois composantes convergeront comme prochaine étape dans l’évolution de la recherche. Cela arrive.

Stein a expliqué :

« Je peux vous dire qu’il y a en quelque sorte trois grands éléments dans la façon dont nous pouvons penser à la recherche par l’IA et à la prochaine génération d’expériences de recherche. L’un est évidemment les aperçus de l’IA, qui sont l’IA rapide et rapide que vous obtenez en haut de la page que beaucoup de gens ont vue. Et c’est évidemment quelque chose qui se développe très, très rapidement. C’est lorsque vous posez une question naturelle, vous la mettez dans Google, vous obtenez cette IA maintenant. Elle est vraiment utile pour les gens.

La seconde concerne le multimodal. Il s’agit d’une recherche visuelle et d’un objectif. C’est l’autre gros morceau. Vous accédez à la caméra dans l’application Google, et cela connaît une forte croissance.

Et puis, avec le mode IA, tout est réuni. Il crée une expérience de recherche frontalière de bout en bout sur des modèles de pointe pour vous permettre de vraiment demander n’importe quoi à la recherche Google.

Mode IA déclenché par des requêtes complexes

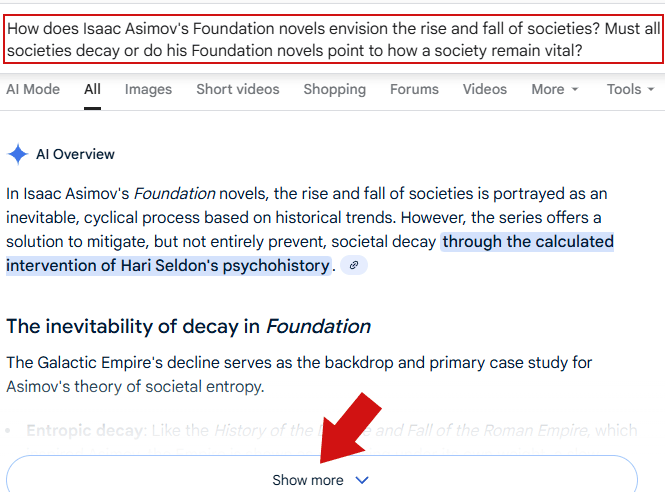

La capture d’écran ci-dessus montre une requête de recherche complexe de deux phrases saisie dans le champ de recherche de Google. La requête complexe déclenche automatiquement un aperçu du mode AI avec un lien « Afficher plus » qui mène à une expérience de recherche conversationnelle immersive en mode AI. Les éditeurs qui souhaitent être cités doivent réfléchir à la manière dont leur contenu s’intégrera dans ce type de contexte.

Nouvelle génération de Google : le mode IA est comme un cerveau

Stein a décrit la prochaine frontière de la recherche comme quelque chose de radicalement différent de ce que nous appelons la recherche Google. De nombreux référenceurs considèrent encore la recherche comme ce paradigme de classement avec dix liens bleus. C’est quelque chose qui n’existe pas vraiment depuis que Google a lancé les Featured Snippets en 2014. Cela fait onze ans que le concept des dix liens bleus est en décalage avec la réalité des résultats de recherche de Google.

Ce que Stein décrit ensuite supprime complètement le concept de dix liens bleus, le remplaçant par le concept d’un cerveau avec lequel les utilisateurs peuvent poser des questions et interagir. Les référenceurs, les commerçants et autres éditeurs doivent vraiment commencer à abandonner le concept mental des dix liens bleus et se concentrer sur la présentation du contenu dans un environnement interactif en langage naturel qui est complètement en dehors de la recherche.

Stein a expliqué ce nouveau concept de cerveau dans le contexte du mode AI :

« Vous pouvez aller et venir. Vous pouvez avoir une conversation. Et il exploite et est spécialement conçu pour la recherche. Alors qu’est-ce que cela signifie ? L’une des choses intéressantes que je pense qu’il fait, c’est qu’il est capable de comprendre toutes ces informations incroyablement riches qui se trouvent dans Google.

- Il y a donc 50 milliards de produits dans le Google Shopping Graph, par exemple. Ils sont mis à jour 2 milliards de fois par heure par les commerçants avec des prix en direct.

- Vous disposez de 250 millions de lieux et de cartes.

- Vous disposez de toutes les informations financières.

- Et sans oublier que vous disposez de tout le contexte du Web et de la manière de vous y connecter afin d’obtenir le contexte, puis d’approfondir.

Et vous mettez tout cela dans ce cerveau qui est effectivement cette façon de parler à Google et d’acquérir ces connaissances.

C’est vraiment ce que vous pouvez faire maintenant. Vous pouvez donc demander tout ce qui vous passe par la tête et il utilisera toutes ces informations pour, espérons-le, vous fournir des informations éclairées et de très haute qualité du mieux que nous pouvons.

La description de Stein montre que l’orientation à long terme de Google est d’aller au-delà de la récupération vers un mode interactif de découverte d’informations au tour par tour. La métaphore du « cerveau » indique que la recherche consistera de moins en moins à localiser des pages Web mais à générer des réponses éclairées construites à partir des données structurées, des graphiques de connaissances et du contenu Web de Google. Cela représente un changement fondamental et comme vous le verrez dans les paragraphes suivants, ce changement se produit en ce moment même.

Le mode IA intègre tout

Stein décrit comment Google déclenche de plus en plus le mode IA comme la prochaine évolution de la façon dont les utilisateurs trouvent des réponses aux questions et découvrent des informations sur le monde qui les entoure immédiatement. Cela va au-delà de la question « quel est le meilleur kayak » et devient davantage une conversation en langage naturel, un voyage d’information qui peut inclure des images, des vidéos et du texte, comme dans la vraie vie. C’est une expérience intégrée qui va bien au-delà d’un simple champ de recherche et de dix liens.

Stein a fourni plus d’informations sur ce à quoi cela ressemblera :

« Et vous pouvez l’utiliser directement sur google.com/ai, mais il a également été intégré à nos expériences principales. Nous avons donc annoncé que vous pouvez y accéder très facilement. Vous pouvez désormais poser des questions complémentaires sur les aperçus de l’IA directement en mode IA.

Idem pour les objectifs, prenez une photo, passez-la en mode AI. Vous pouvez donc poser des questions complémentaires et y accéder également. Il s’agit donc de plus en plus d’une expérience intégrée au cœur du produit.

Comment l’IA convergera en une seule interface

À ce stade, l’animateur du podcast a demandé une explication plus claire de la manière dont toutes ces choses seront intégrées.

Il a demandé :

« J’imagine qu’une grande partie de cela est… attendez de voir comment les gens l’utilisent. Mais quelle est la vision de la façon dont toutes ces choses sont connectées ? »

L’idée est-elle de continuer à avoir ce mode IA à côté, les aperçus de l’IA en haut, et ensuite cette expérience multimodale ? Ou existe-t-il une vision visant à les rapprocher encore davantage au fil du temps ? »

Stein a répondu que tous ces modes de découverte d’informations convergeraient ensemble. Google pourra détecter par la requête s’il faut déclencher le mode AI ou simplement une simple recherche. Il n’y aura pas d’interfaces différentes, juste une.

Stein a expliqué :

« Je pense qu’il y a une opportunité pour que ceux-ci se rapprochent. Je pense que c’est ce que représente le mode AI, du moins pour les expériences de base de l’IA. Mais je les considère comme très complémentaires au produit de recherche principal.

Vous devriez donc pouvoir ne pas avoir à réfléchir à l’endroit où vous posez une question. En fin de compte, vous allez simplement sur Google.

Et aujourd’hui, si vous mettez ce que vous voulez, nous commençons en fait à utiliser une grande partie de la puissance du mode IA, directement dans les aperçus de l’IA. Vous pouvez donc simplement demander très fort, vous pouvez insérer une question de cinq phrases directement dans la recherche Google.

Vous pouvez l’essayer. Et puis ça devrait déclencher l’IA en haut, c’est un aperçu. Et puis vous pouvez approfondir le mode IA et faire des allers-retours. Voilà donc comment ces choses se connectent.

Idem pour votre appareil photo. Donc si vous prenez une photo de quelque chose, par exemple, quelle est cette plante ? Ou comment puis-je acheter ces chaussures ? Cela devrait vous amener à un petit aperçu de l’IA. Et puis si vous allez plus loin, encore une fois, il est alimenté par le mode IA. Vous pouvez faire des allers-retours.

Vous ne devriez donc pas avoir à y penser. En fin de compte, cela devrait ressembler à une expérience produit cohérente et simple. Mais évidemment, c’est une nouveauté pour nous. Nous voulions donc le démarrer de manière à ce que les gens puissent l’utiliser et nous faire part de leurs commentaires avec quelque chose comme un point d’entrée direct, comme google.com/AI.

La réponse de Stein montre que Google passe de fonctionnalités d’IA distinctes à un système de recherche unifié qui interprète automatiquement l’intention et le contexte.

- Pour les utilisateurs, cela signifie que taper, parler ou prendre une photo seront tous connectés au même processus sous-jacent qui décide comment réagir.

- Pour les éditeurs et les référenceurs, cela signifie que la visibilité dépendra moins de l’optimisation des mots-clés que de l’alignement du contenu sur la manière dont Google comprend et répond aux différents types de questions.

Comment le contenu peut s’intégrer dans les expériences de recherche déclenchées par l’IA

Google fait passer les utilisateurs du paradigme traditionnel des dix liens bleus à une expérience d’IA mixte. Les utilisateurs peuvent déjà saisir des questions composées de plusieurs phrases et Google passera automatiquement à une question et réponse approfondie en mode IA. La réponse est un aperçu avec une option permettant de déclencher une conversation plus approfondie.

Robbie Stein a indiqué que l’expérience AI Search convergera encore davantage, en fonction des commentaires des utilisateurs et de la manière dont ils interagissent avec elle.

Il s’agit de changements profonds qui obligent les éditeurs à se poser de profondes questions sur la manière dont le contenu :

- Devriez-vous réfléchir à la manière dont la conservation d’images uniques, de contenu vidéo utile et de didacticiels étape par étape peut s’intégrer dans vos stratégies de contenu ?

- La découverte d’informations est de plus en plus conversationnelle, votre contenu s’inscrit-il dans ce contexte ?

- La découverte d’informations peut de plus en plus inclure des instantanés de caméra, votre contenu s’adaptera-t-il à ce type de recherche ?

Ce sont des exemples du type de questions auxquelles les éditeurs, les référenceurs et les propriétaires de magasins devraient réfléchir.

Regardez l’interview en podcast avec Robby Stein

Dans le revirement de l’IA de Google : mode IA, aperçus de l’IA et vision de la recherche basée sur l’IA | Robby Stein

Image en vedette/Capture d’écran de la vidéo du podcast de Lenny

Commentaires